Interfejs Live API umożliwia interakcje z Gemini w czasie rzeczywistym z użyciem głosu i wzroku przy niewielkich opóźnieniach. Przetwarza ciągłe strumienie dźwięku, obrazów i tekstu, aby dostarczać natychmiastowe odpowiedzi głosowe przypominające ludzkie wypowiedzi, co zapewnia użytkownikom naturalną rozmowę.

Przypadki użycia

Interfejs Live API może być używany do tworzenia agentów głosowych działających w czasie rzeczywistym w różnych branżach, m.in.:

- E-commerce i handel detaliczny: asystenci zakupów, którzy oferują spersonalizowane rekomendacje, oraz agenci obsługi klienta, którzy rozwiązują problemy klientów.

- Gry: interaktywne postacie niezależne, pomoc w grze i tłumaczenie treści w czasie rzeczywistym.

- Interfejsy nowej generacji: funkcje głosowe i wideo w robotyce, inteligentnych okularach i pojazdach.

- Opieka zdrowotna: asystenci zdrowia, którzy wspierają pacjentów i edukują ich.

- Usługi finansowe: doradcy AI w zakresie zarządzania majątkiem i inwestycjami.

- Edukacja: mentorzy i towarzysze nauki oparte na AI, którzy zapewniają spersonalizowane instrukcje i opinie.

Najważniejsze funkcje

Interfejs Live API oferuje kompleksowy zestaw funkcji do tworzenia zaawansowanych agentów głosowych:

- Obsługa wielu języków: rozmawiaj w 70 obsługiwanych językach.

- Przerwanie: użytkownicy mogą w dowolnym momencie przerwać działanie modelu, aby uzyskać interaktywne odpowiedzi.

- Korzystanie z narzędzi: integruje narzędzia takie jak wywoływanie funkcji i wyszukiwarka Google, aby umożliwiać dynamiczne interakcje.

- Transkrypcje audio: udostępnia transkrypcje tekstowe zarówno danych wejściowych użytkownika, jak i danych wyjściowych modelu.

- Aktywny dźwięk: pozwala kontrolować, kiedy i w jakich kontekstach model odpowiada.

- Dialog afektywny: dostosowuje styl i ton odpowiedzi do ekspresji użytkownika.

Specyfikacja techniczna

W tabeli poniżej znajdziesz dane techniczne interfejsu Live API:

| Kategoria | Szczegóły |

|---|---|

| Rodzaje danych wejściowych | Audio (surowe 16-bitowe audio PCM, 16 kHz, little-endian), obrazy (JPEG <= 1 kl./s), tekst |

| Rodzaje danych wyjściowych | Audio (surowe 16-bitowe audio PCM, 24 kHz, little-endian) |

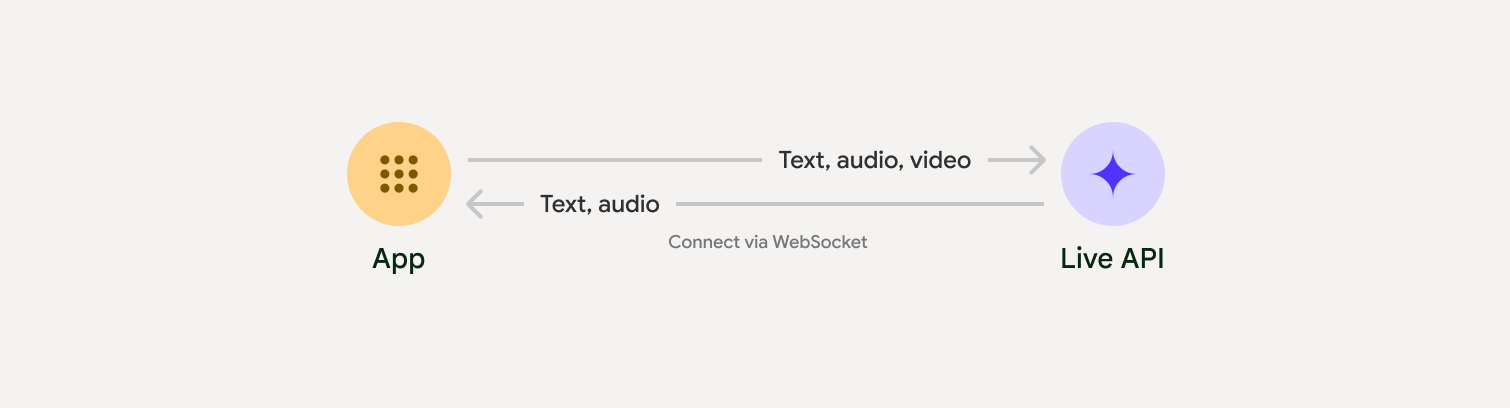

| Protokół | Połączenie WebSocket z zachowaniem stanu (WSS) |

Wybierz metodę implementacji

Podczas integracji z interfejsem Live API musisz wybrać jedną z tych metod implementacji:

- Serwer-serwer: backend łączy się z interfejsem Live API za pomocą WebSockets. Zwykle klient wysyła dane strumieniowe (audio, wideo, tekst) na serwer, który następnie przekazuje je do interfejsu Live API.

- Klient–serwer: kod frontendu łączy się bezpośrednio z interfejsem Live API za pomocą WebSockets, aby przesyłać strumieniowo dane z pominięciem backendu.

Rozpocznij

Wybierz przewodnik odpowiedni dla Twojego środowiska programistycznego:

Samouczek dotyczący pakietu GenAI SDK

Połącz się z interfejsem Gemini Live API za pomocą pakietu GenAI SDK, aby utworzyć wielomodową aplikację w czasie rzeczywistym z backendem w Pythonie.

Samouczek dotyczący WebSocket

Połącz się z interfejsem Gemini Live API za pomocą protokołu WebSocket, aby utworzyć multimodalną aplikację w czasie rzeczywistym z interfejsem JavaScript i tokenami tymczasowymi.

Samouczek pakietu ADK

Tworzenie agenta i używanie pakietu Agent Development Kit (ADK) Streaming do włączania komunikacji głosowej i wideo.

Integracje z partnerami

Aby usprawnić programowanie aplikacji audio i wideo działających w czasie rzeczywistym, możesz użyć integracji z usługami innych firm, która obsługuje interfejs Gemini Live API przez WebRTC lub WebSockets.

LiveKit

Korzystanie z interfejsu Gemini Live API z agentami LiveKit.

Pipecat by Daily

Tworzenie czatbota AI działającego w czasie rzeczywistym za pomocą Gemini Live i Pipecat

Fishjam od Software Mansion

Twórz aplikacje do strumieniowego przesyłania obrazu na żywo i audio za pomocą Fishjam.

Agenty Vision według strumienia

Twórz aplikacje AI do obsługi głosu i wideo w czasie rzeczywistym za pomocą agentów Vision.

Voximplant

Łączenie połączeń przychodzących i wychodzących z interfejsem Live API za pomocą Voximplant.

Pakiet Firebase AI SDK

Pierwsze kroki z interfejsem Gemini Live API za pomocą Firebase AI Logic.