Live API की मदद से, Gemini के साथ कम समय में रीयल-टाइम में आवाज़ और विज़न से जुड़ी बातचीत की जा सकती है. यह ऑडियो, इमेज, और टेक्स्ट की लगातार स्ट्रीम को प्रोसेस करता है, ताकि आपको तुरंत और इंसानों जैसी आवाज़ में जवाब मिल सकें. इससे आपके उपयोगकर्ताओं को बातचीत का नैचुरल अनुभव मिलता है.

उपयोग के उदाहरण

Live API का इस्तेमाल, कई तरह के उद्योगों के लिए रीयल-टाइम में काम करने वाले वॉइस एजेंट बनाने के लिए किया जा सकता है. जैसे:

- ई-कॉमर्स और खुदरा कारोबार: शॉपिंग असिस्टेंट, लोगों की दिलचस्पी के हिसाब से सुझाव देती हैं. साथ ही, सहायता एजेंट, खरीदारों की समस्याओं को हल करते हैं.

- गेमिंग: इंटरैक्टिव नॉन-प्लेयर कैरेक्टर (एनपीसी), गेम में मदद करने वाले असिस्टेंट, और गेम में मौजूद कॉन्टेंट का रीयल-टाइम में अनुवाद करने की सुविधा.

- नेक्स्ट जनरेशन इंटरफ़ेस: रोबोटिक्स, स्मार्ट ग्लास, और वाहनों में आवाज़ और वीडियो की सुविधा वाले अनुभव.

- स्वास्थ्य सेवा: मरीज़ों की मदद करने और उन्हें शिक्षित करने के लिए स्वास्थ्य से जुड़े कंपैनियन.

- वित्तीय सेवाएं: संपत्ति प्रबंधन और निवेश के बारे में सलाह देने के लिए एआई सलाहकार.

- शिक्षा: एआई मेंटर और सीखने वाले लोगों के लिए कंपैनियन, जो उनके हिसाब से निर्देश और सुझाव देते हैं.

मुख्य सुविधाएं

Live API में, आवाज़ से काम करने वाले एजेंट बनाने के लिए कई सुविधाएं उपलब्ध हैं:

- कई भाषाओं में उपलब्ध: 70 भाषाओं में बातचीत करें.

- बार्ज-इन: उपयोगकर्ता, जवाब देने वाले इंटरैक्शन के लिए किसी भी समय मॉडल को बाधित कर सकते हैं.

- टूल का इस्तेमाल करना: इसमें फ़ंक्शन कॉलिंग और Google Search जैसे टूल इंटिग्रेट किए जाते हैं, ताकि डाइनैमिक इंटरैक्शन किया जा सके.

- ऑडियो ट्रांसक्रिप्शन: इसमें उपयोगकर्ता के इनपुट और मॉडल के आउटपुट, दोनों के टेक्स्ट ट्रांसक्रिप्ट शामिल होते हैं.

- पहले से तैयार जवाब देने की सुविधा: इस सुविधा की मदद से, यह कंट्रोल किया जा सकता है कि मॉडल कब और किन संदर्भों में जवाब दे.

- भावनाओं के हिसाब से बातचीत करना: इसमें जवाब देने की स्टाइल और टोन को, उपयोगकर्ता के इनपुट के हिसाब से बदला जाता है.

तकनीकी जानकारी

यहां दी गई टेबल में, Live API की तकनीकी खास जानकारी दी गई है:

| कैटगरी | विवरण |

|---|---|

| इनपुट के तरीके | ऑडियो (रॉ 16-बिट पीसीएम ऑडियो, 16 किलोहर्ट्ज़, लिटिल-एंडियन), इमेज (JPEG <= 1 एफ़पीएस), टेक्स्ट |

| आउटपुट के तरीके | ऑडियो (रॉ 16-बिट पीसीएम ऑडियो, 24 किलोहर्ट्ज़, लिटिल-एंडियन) |

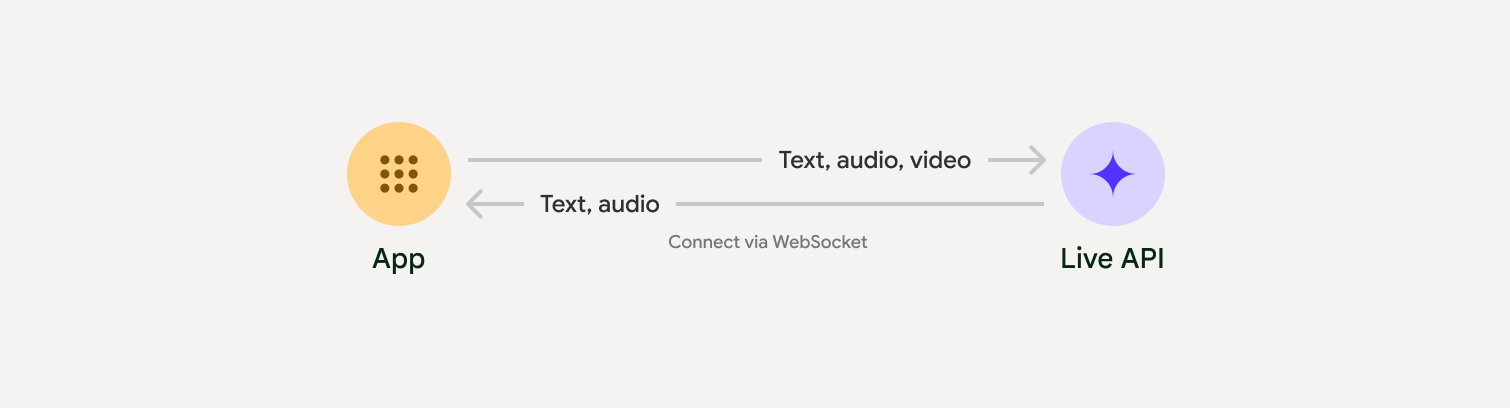

| प्रोटोकॉल | स्टेटफ़ुल WebSocket कनेक्शन (WSS) |

लागू करने का तरीका चुनना

Live API के साथ इंटिग्रेट करते समय, आपको लागू करने के लिए इनमें से कोई एक तरीका चुनना होगा:

- सर्वर-टू-सर्वर: आपका बैकएंड, WebSockets का इस्तेमाल करके Live API से कनेक्ट होता है. आम तौर पर, आपका क्लाइंट स्ट्रीम डेटा (ऑडियो, वीडियो, टेक्स्ट) को आपके सर्वर पर भेजता है. इसके बाद, सर्वर उसे Live API को भेजता है.

- क्लाइंट-टू-सर्वर: आपका फ़्रंटएंड कोड, डेटा स्ट्रीम करने के लिए WebSockets का इस्तेमाल करके, सीधे तौर पर Live API से कनेक्ट होता है. इससे आपका बैकएंड बायपास हो जाता है.

अपनी प्रोफ़ाइल बनाना शुरू करें

अपने डेवलपमेंट एनवायरमेंट से मेल खाने वाली गाइड चुनें:

GenAI SDK ट्यूटोरियल

Python बैकएंड की मदद से, रीयल-टाइम में मल्टीमॉडल ऐप्लिकेशन बनाने के लिए, GenAI SDK का इस्तेमाल करके Gemini Live API से कनेक्ट करें.

WebSocket ट्यूटोरियल

WebSockets का इस्तेमाल करके, Gemini Live API से कनेक्ट करें. इससे JavaScript फ़्रंटएंड और कुछ समय के लिए मान्य टोकन के साथ, रीयल-टाइम मल्टीमॉडल ऐप्लिकेशन बनाया जा सकता है.

ADK ट्यूटोरियल

कोई एजेंट बनाएं और आवाज़ और वीडियो के ज़रिए बातचीत करने की सुविधा चालू करने के लिए, Agent Development Kit (ADK) स्ट्रीमिंग का इस्तेमाल करें.

पार्टनर इंटिग्रेशन

रीयल-टाइम में ऑडियो और वीडियो ऐप्लिकेशन को आसानी से डेवलप करने के लिए, तीसरे पक्ष के इंटिग्रेशन का इस्तेमाल किया जा सकता है. यह इंटिग्रेशन, WebRTC या WebSockets के बजाय Gemini Live API के साथ काम करता है.

LiveKit

LiveKit एजेंट के साथ Gemini Live API का इस्तेमाल करें.

Pipecat by Daily

Gemini Live और Pipecat का इस्तेमाल करके, रीयल-टाइम में एआई चैटबॉट बनाना.

Software Mansion का Fishjam

Fishjam की मदद से, लाइव वीडियो और ऑडियो स्ट्रीमिंग ऐप्लिकेशन बनाएं.

स्ट्रीम के हिसाब से विज़न एजेंट

Vision Agents की मदद से, रीयल-टाइम में काम करने वाले वॉइस और वीडियो एआई ऐप्लिकेशन बनाएं.

Voximplant

Voximplant की मदद से, आने वाले और जाने वाले कॉल को Live API से कनेक्ट करें.

अगोरा

Agora की मदद से, रीयल-टाइम में बातचीत करने वाले एआई ऐप्लिकेशन बनाएं.

Firebase AI SDK

Firebase AI Logic का इस्तेमाल करके, Gemini Live API का इस्तेमाल शुरू करें.