इसे TensorFlow Lite के भरोसेमंद फ़्रेमवर्क पर बनाया गया है

LiteRT सिर्फ़ नया नहीं है, बल्कि यह दुनिया में सबसे ज़्यादा इस्तेमाल किए जाने वाले मशीन लर्निंग रनटाइम की अगली जनरेशन है. यह आपके रोज़ाना इस्तेमाल किए जाने वाले ऐप्लिकेशन को बेहतर बनाता है. साथ ही, अरबों डिवाइसों पर कम समय में डेटा ट्रांसफ़र करने और ज़्यादा निजता देने में मदद करता है.

Google के सबसे ज़रूरी ऐप्लिकेशन के लिए भरोसेमंद

एक लाख से ज़्यादा ऐप्लिकेशन, दुनिया भर के अरबों उपयोगकर्ता

LiteRT की खास बातें

क्रॉस प्लैटफ़ॉर्म के लिए तैयार

GenAI की सुविधा का इस्तेमाल करना

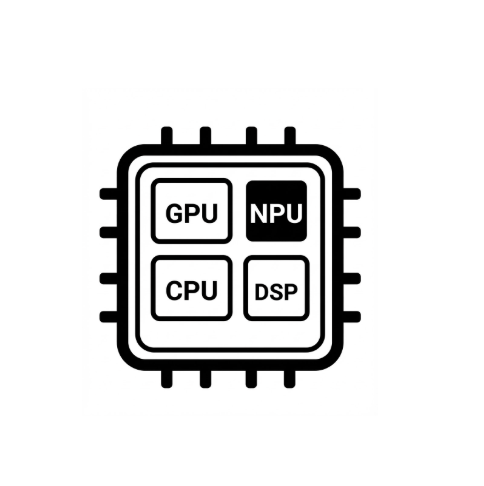

हार्डवेयर से तेज़ी लाने की सुविधा को आसान बनाना

एक से ज़्यादा फ़्रेमवर्क इस्तेमाल करने की सुविधा

LiteRT के ज़रिए लागू करना

ट्रेनिंग से लेकर डिवाइस पर डिप्लॉयमेंट तक, डीप लर्निंग के वर्कफ़्लो को आसान बनाएं.

1.मॉडल पाना

पहले से ट्रेन किए गए .tflite मॉडल का इस्तेमाल करें या PyTorch, JAX या TensorFlow मॉडल को .tflite में बदलें.

2.ऑप्टिमाइज़ करें

ट्रेनिंग के बाद अपने मॉडल को क्वांटाइज़ करने के लिए, LiteRT ऑप्टिमाइज़ेशन टूलकिट का इस्तेमाल करें.

3.रन

LiteRT की मदद से अपने मॉडल को डिप्लॉय करें और अपने ऐप्लिकेशन के लिए सबसे अच्छा ऐक्सलरेटर चुनें.

अपने डेवलपमेंट का तरीका चुनना

LiteRT का इस्तेमाल करके, एआई को कहीं भी डिप्लॉय किया जा सकता है. जैसे, हाई-परफ़ॉर्मेंस वाले मोबाइल ऐप्लिकेशन से लेकर, सीमित संसाधनों वाले IoT डिवाइसों तक.

TFLite का मौजूदा उपयोगकर्ता

LiteRT पर ट्रांज़िशन किया जा रहा है, ताकि सभी प्लैटफ़ॉर्म (Android, डेस्कटॉप, वेब) पर बेहतर परफ़ॉर्मेंस और यूनिफ़ाइड एपीआई का फ़ायदा मिल सके.

BYOM : Bring your own Models

आपके पास PyTorch मॉडल हो और आपको डिवाइस पर विज़न या ऑडियो से जुड़ी सुविधाएं लागू करनी हों.

जनरेटिव एआई मॉडल डिप्लॉय करना

Gemma या किसी अन्य ओपन-वेट मॉडल जैसे ऑप्टिमाइज़ किए गए ओपन-वेट जेन एआई मॉडल का इस्तेमाल करके, डिवाइस पर बेहतर चैटबॉट बनाना.

[ऐडवांस] मॉडल एक्सपर्ट

कस्टम मॉडल बनाना या बेहतर परफ़ॉर्मेंस के लिए, हार्डवेयर के हिसाब से सीपीयू/जीपीयू/एनपीयू को ऑप्टिमाइज़ करना.

सैंपल, मॉडल, और डेमो

GitHub पर LiteRT का सैंपल ऐप्लिकेशन देखें

शुरू से आखिर तक के पूरे सैंपल ऐप्लिकेशन.

जेन एआई मॉडल देखना

पहले से ट्रेन किए गए, इस्तेमाल के लिए तैयार जेन एआई मॉडल.

डेमो देखें - Google AI Edge Gallery ऐप्लिकेशन

यह गैलरी, LiteRT का इस्तेमाल करके डिवाइस पर एमएल/जेन एआई के इस्तेमाल के उदाहरण दिखाती है.

ब्लॉग और एलान

LiteRT टीम से जुड़े नए एलान, तकनीकी जानकारी, और परफ़ॉर्मेंस बेंचमार्क के बारे में अप-टू-डेट रहें.

LiteRT: डिवाइस पर मौजूद एआई के लिए यूनिवर्सल फ़्रेमवर्क

Google का यूनिफ़ाइड ऑन-डिवाइस एमएल फ़्रेमवर्क, जो हाई-परफ़ॉर्मेंस वाले डिप्लॉयमेंट के लिए TFLite से विकसित हुआ है.

MediaTek NPU और LiteRT: डिवाइस पर मौजूद अगली जनरेशन के एआई को बेहतर बनाने के लिए

ज़्यादा बेहतर तरीके से काम करने वाले एआई के लिए, MediaTek चिपसेट में एनपीयू ऐक्सेलरेटेड सपोर्ट को बढ़ाया गया है.

LiteRT की मदद से, Qualcomm NPU पर बेहतर परफ़ॉर्मेंस पाना

Qualcomm के न्यूरल प्रोसेसिंग यूनिट पर जनरेटिव एआई की परफ़ॉर्मेंस को बेहतर बनाया गया है.

LiteRT: ज़्यादा से ज़्यादा परफ़ॉर्मेंस, आसान तरीके से

हार्डवेयर को अपने-आप चुनने और एसिंक एक्ज़ीक्यूशन के लिए, CompiledModel API लॉन्च किया गया है.

Chrome, Chromebook Plus, और Pixel Watch में डिवाइस पर काम करने वाला जनरेटिव एआई, LiteRT-LM की मदद से

LiteRT-LM का इस्तेमाल करके, पहनने लायक डिवाइसों और ब्राउज़र पर आधारित प्लैटफ़ॉर्म पर भाषा मॉडल डिप्लॉय करें.

Google के एआई एज के स्मॉल लैंग्वेज मॉडल, मल्टीमॉडल, और फ़ंक्शन कॉलिंग

एज लैंग्वेज मॉडल के लिए, RAG, मल्टीमॉडल, और फ़ंक्शन कॉलिंग के बारे में नई अहम जानकारी

समुदाय में शामिल हों.

LiteRT GitHub कम्यूनिटी

प्रोजेक्ट में सीधे तौर पर योगदान दें और मुख्य डेवलपर के साथ मिलकर काम करें.

Hugging Face Hub

Hugging Face Hub पर, ऑप्टिमाइज़ किए गए ओपन-वेट मॉडल ऐक्सेस करें.