9 NİSAN 2025

Langbase'de Gemini Flash ile yüksek işleme hızına sahip düşük maliyetli yapay zeka temsilcileri

İşlemlerini ve harici araçlarını bağımsız olarak yönetebilen yapay zeka aracı oluşturmak genellikle entegrasyon ve altyapı engellerini aşmayı gerektirir. Langbase, bu temel karmaşıklıkları yönetme yükünü ortadan kaldırır ve Gemini gibi modeller tarafından desteklenen sunucusuz yapay zeka aracı oluşturup dağıtmak için bir platform sağlar. Üstelik bunu herhangi bir çerçeve olmadan yapar.

Gemini Flash'in kullanıma sunulmasından bu yana Langbase kullanıcıları, bu hafif modelleri aracı deneyimleri için kullanmanın performans ve maliyet avantajlarını kısa sürede fark etti.

Gemini Flash ile ölçeklenebilirlik ve daha hızlı yapay zeka temsilcileri elde etme

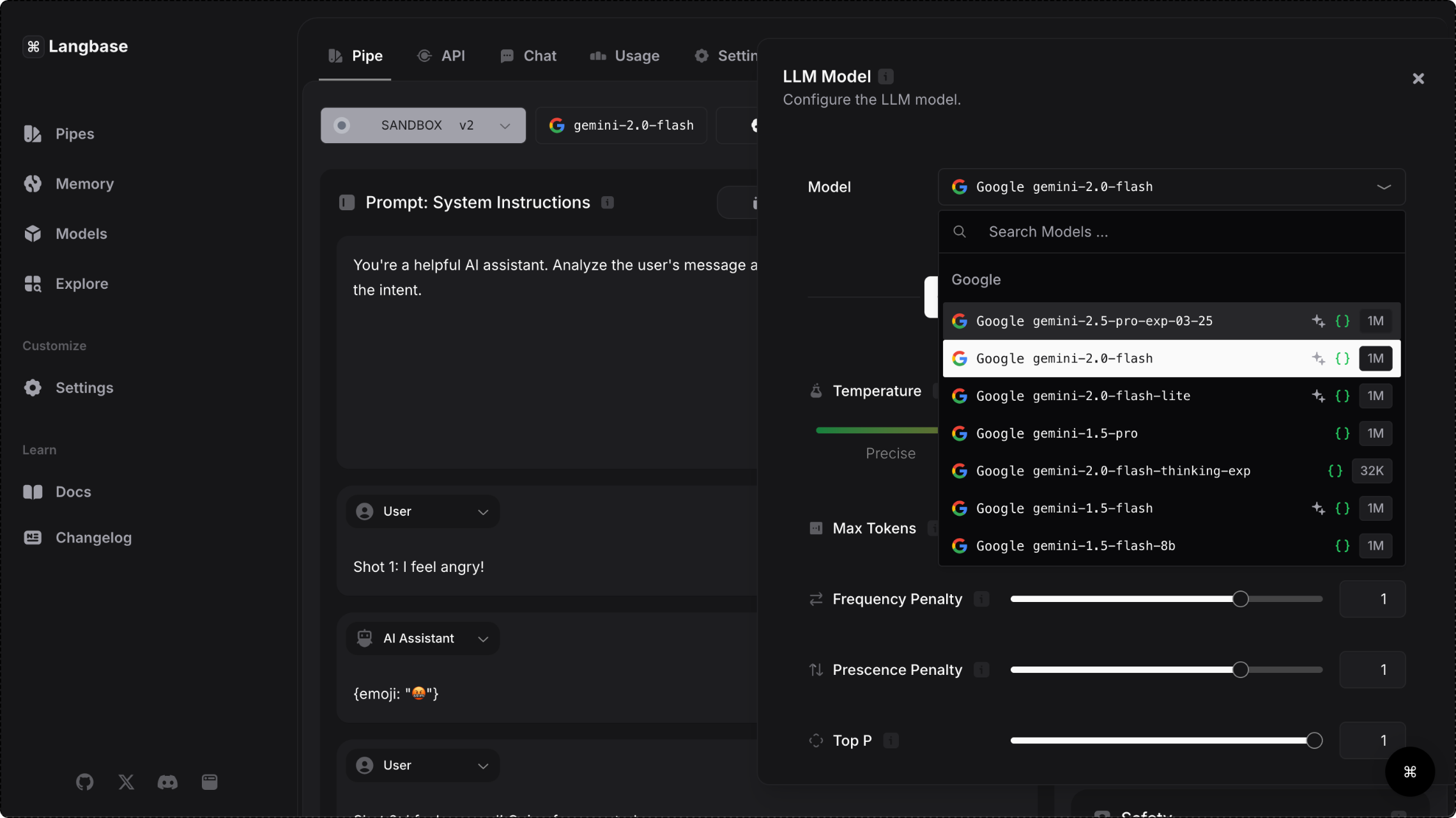

Langbase platformu, Gemini API aracılığıyla Gemini modellerine erişim sağlayarak kullanıcıların karmaşık görevleri yerine getirebilen ve büyük miktarda veriyi işleyebilen hızlı modeller seçmesine olanak tanır. Sorunsuz ve anlık bir deneyim sunmak için düşük gecikme süresi kritik öneme sahip olduğundan Gemini Flash model ailesi, özellikle kullanıcıya yönelik aracıların oluşturulması için uygundur.

Platform kullanıcıları, Gemini 1.5 Flash'i kullandıklarında %28 daha hızlı yanıt sürelerinin yanı sıra %50 daha düşük maliyet ve işlemlerinde %78 daha yüksek verimlilik elde etti. Performanstan ödün vermeden büyük hacimli istekleri işleme özelliği sayesinde Gemini Flash modelleri, sosyal medya içerik oluşturma, araştırma makalesi özetleme ve tıbbi belgelerin aktif analizi gibi kullanım alanlarında yüksek talep gören uygulamalar için açık bir seçimdir.

31,1 parça/sn

Flash ile karşılaştırılabilir modellere kıyasla %78 daha yüksek işleme hızı

7,8 kat

Flash ile karşılaştırılabilir modellere kıyasla daha büyük bağlam penceresi

%28

Flash ile karşılaştırılabilir modellere kıyasla daha hızlı yanıt süreleri

%50

Flash ile karşılaştırılabilir modellere kıyasla daha düşük maliyetler

- Kaynak: Langbase blogu

Langbase, temsilci geliştirmeyi nasıl kolaylaştırır?

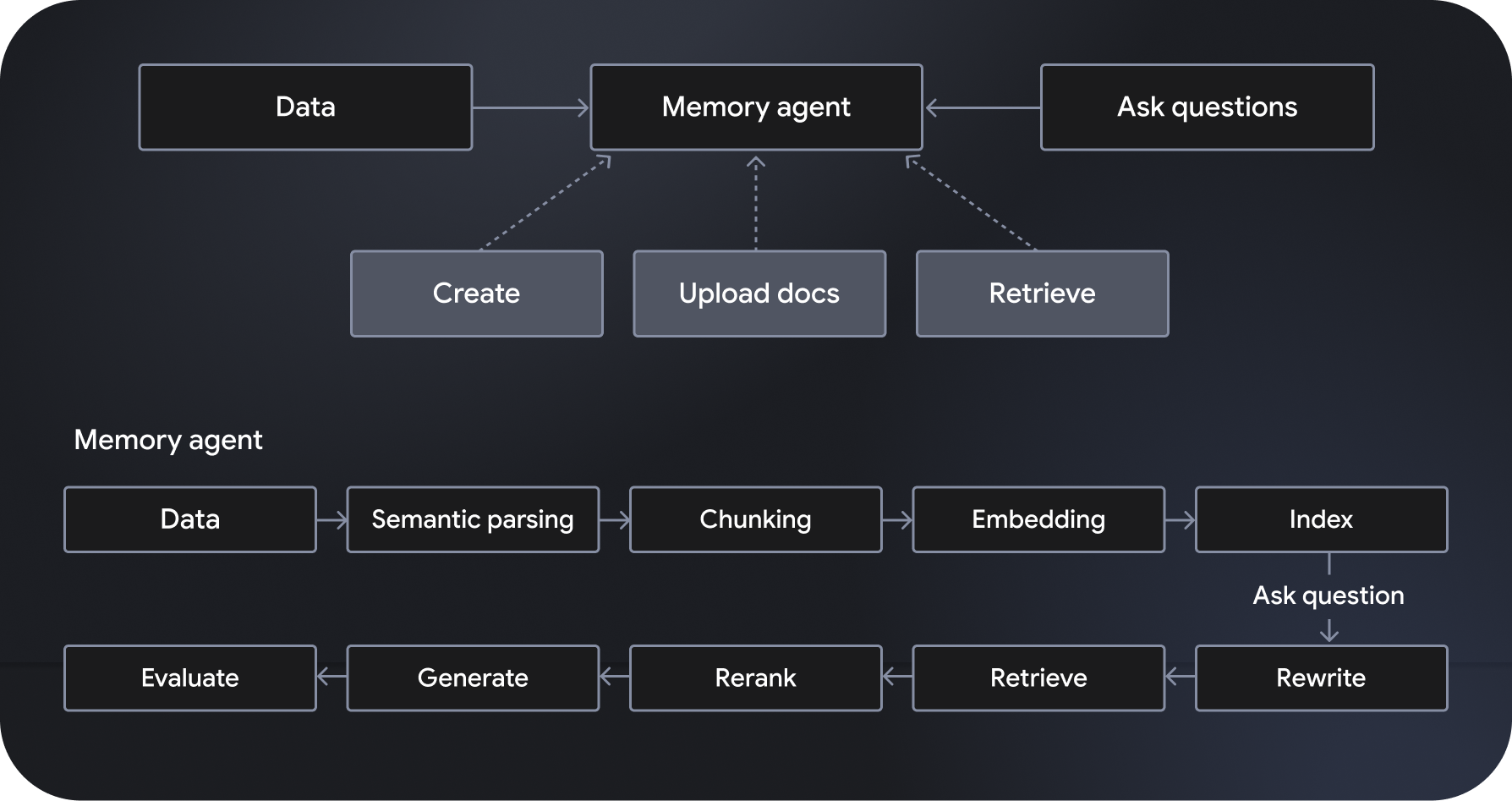

Langbase, sunucusuz yapay zeka aracı geliştirme ve dağıtım platformudur. Bu platform, sunucusuz yapay zeka aracı oluşturulmasına olanak tanır. "Bellek temsilcileri" olarak bilinen, tümüyle yönetilen ve ölçeklenebilir semantik veriyle artırma üretim (RAG) sistemleri sunar. İş akışı düzenleme, veri yönetimi, kullanıcı etkileşimi işleme ve harici hizmetlerle entegrasyon gibi ek özellikler içerir.

Gemini 2.0 Flash gibi modeller tarafından desteklenen "hat temsilcisi", belirtilen talimatlara uyar ve bu talimatlar doğrultusunda hareket eder. Ayrıca web araması ve web taraması gibi güçlü araçlara erişebilir. Diğer taraftan, hafıza aracıları, temellendirilmiş yanıtlar oluşturmak için alakalı verilere dinamik olarak erişir. Langbase'in Pipe ve Memory API'leri, geliştiricilerin güçlü muhakeme yeteneğini yeni veri kaynaklarına bağlayarak, yapay zeka modellerinin bilgi ve faydasını genişleterek güçlü özellikler oluşturmasını sağlar.

Yapay zeka temsilcileri, karmaşık süreçleri otomatikleştirerek, iş akışı verimliliğini artırarak ve kullanıcılara son derece kişiselleştirilmiş deneyimler sunarak daha güçlü uygulamalar için olanaklar sunar. Güçlü muhakeme, düşük maliyet ve daha yüksek hızın birleşimi, Gemini Flash modellerini Langbase kullanıcıları için tercih edilen bir seçenek haline getiriyor. Yüksek verimli ve ölçeklenebilir yapay zeka aracıları oluşturmaya ve dağıtmaya başlamak için platformu keşfedin.